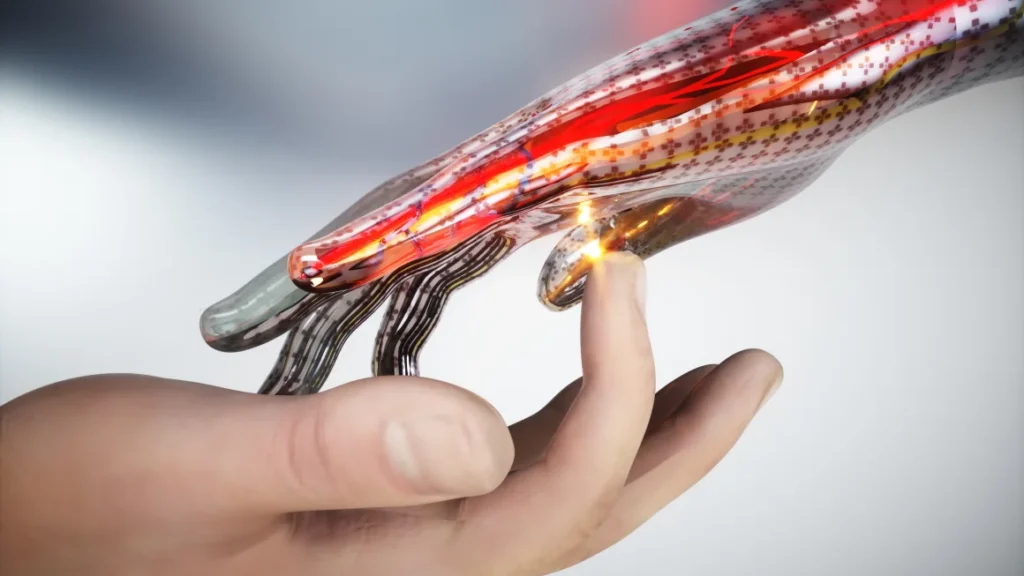

A inteligência artificial (IA) está se infiltrando em todos os setores da economia, e uma das últimas fronteiras é a compreensão das emoções humanas. Empresas estão investindo em algo chamado “IA emocional”, sistemas capazes de interpretar o humor e as intenções por trás das palavras e ações, com o objetivo de criar interações mais personalizadas e eficazes com seus clientes e funcionários.

A promessa da IA emocional

A ideia é simples: se os chatbots e assistentes virtuais puderem entender se uma pergunta é feita com raiva ou com confusão, eles poderão responder de forma mais adequada, construindo relacionamentos mais fortes e aumentando a satisfação do cliente. Essa capacidade é particularmente útil em setores como atendimento ao cliente, vendas e recursos humanos.

Como funciona?

A IA emocional combina técnicas de aprendizado de máquina com a análise de dados visuais, auditivos e textuais. Por exemplo, um sistema pode analisar o tom de voz, as expressões faciais e as palavras-chave em uma conversa para determinar se o usuário está feliz, triste, com raiva ou neutro.

O mercado em expansão

Grandes empresas de tecnologia, como Microsoft e Amazon, já oferecem ferramentas de IA emocional para desenvolvedores. Além disso, um número crescente de startups está surgindo para explorar esse mercado promissor.

Desafios e críticas

No entanto, a IA emocional ainda enfrenta diversos desafios. Um dos principais é a complexidade das emoções humanas. As emoções são subjetivas e podem variar de pessoa para pessoa e de cultura para cultura. Além disso, a precisão dos sistemas de IA emocional ainda é limitada, e há o risco de que eles sejam usados para manipular as pessoas.

Outro ponto crucial é a privacidade. A coleta e análise de dados pessoais para determinar as emoções de alguém levantam questões éticas importantes. Regulamentações como o Ato de IA da União Europeia já buscam limitar o uso da detecção de emoções por visão computacional em determinados contextos.

Um futuro incerto

A IA emocional tem o potencial de revolucionar a forma como interagimos com as máquinas, mas também apresenta riscos e desafios significativos. É fundamental que as empresas e os desenvolvedores utilizem essa tecnologia de forma ética e responsável, garantindo a privacidade dos usuários e evitando a criação de ferramentas que possam ser usadas para manipulação ou discriminação.